IBM zavedla instance s Nvidia H100 GPU na své cloudové platformě.

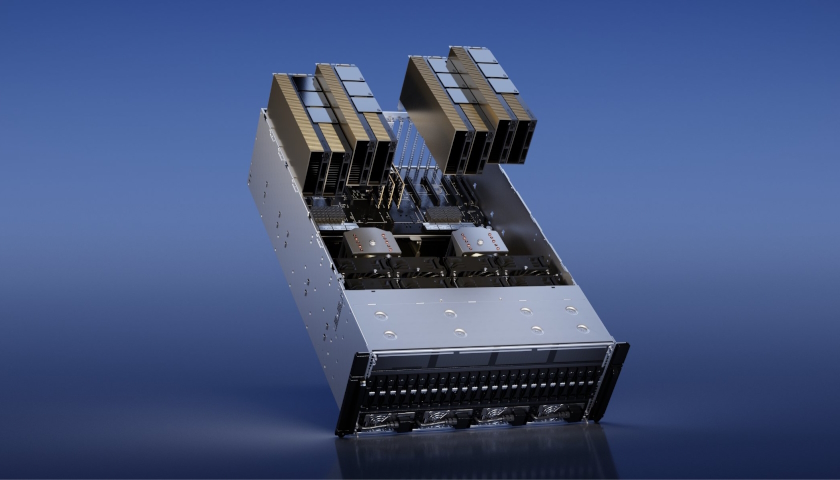

Zákazníci nyní budou moci používat tyto GPU pro pracovní zátěže umělé inteligence (AI), včetně tréninku a inferencí.

Přidání H100 navazuje na nasazení Nvidia A100 GPU IBM v loňském roce. Podle Nvidia nové GPU umožňují výkon inferencí až 30krát rychlejší než A100.

Kromě A100 a H100 nabízí IBM Cloud také Nvidia L40S a L4 GPU, které lze použít pro menší pracovní zátěže AI, jako je trénink modelů malého rozsahu nebo nasazení chatbotů.

Instance s H100 jsou k dispozici ve více zónových regionech IBM v Severní Americe, Latinské Americe, Evropě, Japonsku a Austrálii. IBM plánuje nabídnout AI procesory Intel Gaudi 3 prostřednictvím IBM Cloud začátkem roku 2025.

Zavedení H100 GPU na IBM Cloud staví tuto platformu daleko za konkurenty, kteří tyto GPU mají k dispozici již více než rok v některých případech.

Amazon Web Services (AWS) začal nabízet tyto GPU v červenci 2023, zatímco Google, Microsoft a Oracle spustili H100 v září stejného roku.

Podobně začínající společnosti v oblasti GPU cloudu měly dlouhodobý přístup, mezi které patří například CoreWeave a Cirrascale.

Oracle, Amazon, Microsoft a Google všichni oznámili, že v březnu 2024 nasadí nadcházející řadu Blackwell GPU od Nvidia, přičemž CoreWeave to potvrdil několik měsíců později. Řada Blackwell čelila začátkem tohoto roku některým problémům s designem, ale byly vyřešeny do konce srpna 2024.

Nvidia očekává, že ve 4. čtvrtletí 2024 dodá nový GPU ve výši „několika miliard dolarů“.

Zdroj: datacenterdynamics.com

Zdroj: CLOUD & BACKUP NETWORK NEWS