Gartner: Náklady na AI inferenci mají prudce klesnout

Provádění inference na AI modelu s bilionem parametrů bude poskytovatele velkých jazykových modelů v roce 2030 stát o více než 90 % méně než loni, vyplývá z prognózy analytické společnosti

Provádění inference na AI modelu s bilionem parametrů bude poskytovatele velkých jazykových modelů v roce 2030 stát o více než 90 % méně než loni, vyplývá z prognózy analytické společnosti

Nasazení velkých jazykových modelů (LLM) lokálně, tedy bez přímé závislosti na cloudových službách, představuje rostoucí trend jak pro jednotlivce, tak pro organizace hledající větší kontrolu, soukromí a potenciálně i nákladovou

Státní operátor China Telecom vyvinul dva modely LLM, které byly kompletně vyškoleny na procesorech domácí výroby. Tento průlomový objev dokládá pokrok Číny na cestě k nezávislosti na čipech, zejména v

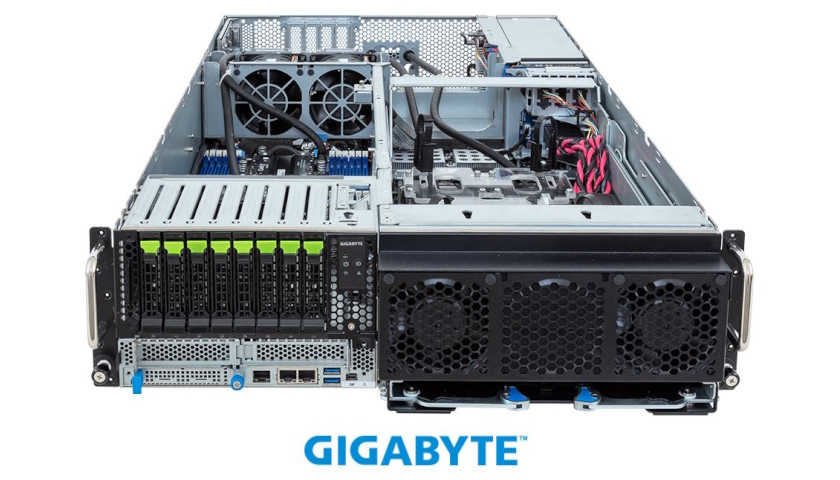

Giga Computing nabízí dva nové servery s GPU pro platformu Intel Xeon Scalable CPU 4. generace a NVIDIA HGX H100 se 4 a 8 GPU. Nový server GIGABYTE G363-SR0 vyniká

Společnost Asbis představuje novinky v nabídce serverů firmy Giga Computing, která nově nabízí řadu výkonných GPU serverů s nejnovějšími procesory Intel, včetně serverů NVIDIA HGX H100 se 4 i 8